微信联系方式

扫描二维码添加微信

微信号:18103268866

扫描二维码添加微信

微信号:18103268866

扫描二维码添加QQ

QQ号:3525642302

请使用微信扫描二维码查看当前页面

了解我们的最新动态、行业资讯和技术分享

在这个 LLM 飞速演进的时代,我们总习惯将“进步”归功于新的模型架构、算法创新或更炫的技术名词。而本文作者提出了一个值得深思的观点:AI 的真正飞跃,或许从来都不是由“新想法”驱动,而是“新数据源”

Moxin-7B证明了一点:高性能LLM不必是黑箱。它的全透明策略不仅降低了研究门槛,还为中小企业提供了可控的AI解决方案。Moxin-7B-Base 权重、预训练数据与代码Moxin-7B-Inst

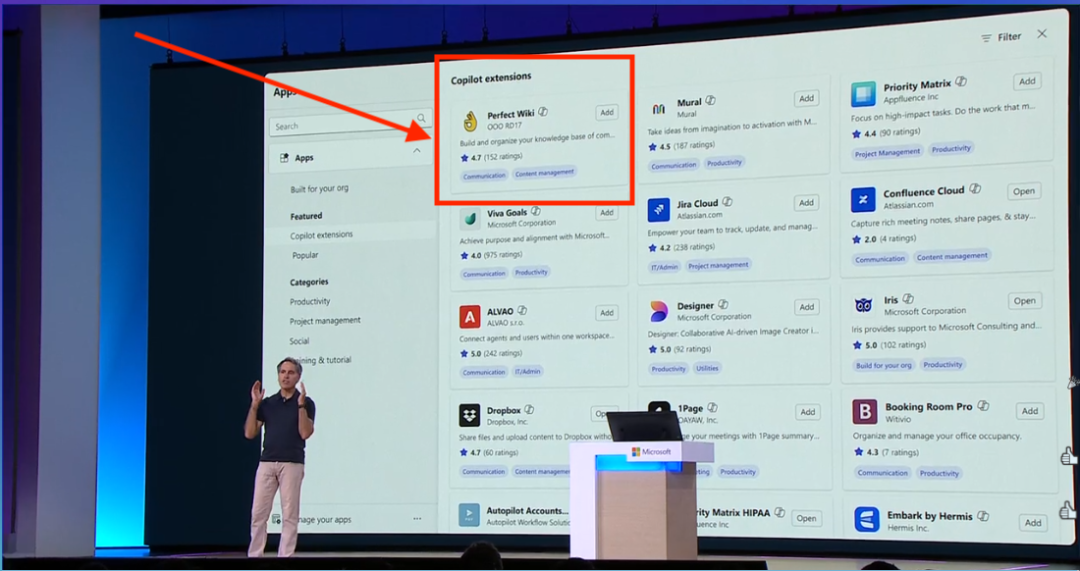

模型上下文协议(MCP) 是一种让 LLM 与外部工具、数据源打通的机制,听起来很美好:模型不再局限于内部知识,而是可以实时调用各种工具、访问各种文档...殊不知,现实远比想象复杂。